Как инцидент с PocketOS показал фундаментальные проблемы безопасности ИИ-агентов, и почему одних ограничений внутри модели уже недостаточно

Безопасность агентского ИИ вызывает тревогу уже давно. Об этом говорят и исследователи, и разработчики систем безопасности, в том числе в «Лаборатории Касперского». Ранние эксперименты с агентами уже показывали, насколько рискованно давать модели автономный доступ к пользовательским данным и системам: локальный агент OpenClaw, например, мог удалять письма или раскрывать чувствительную информацию. Но теперь индустрия столкнулась с новым этапом проблемы — инцидентами, где ошибки или опасные действия ИИ-агентов начинают напрямую влиять на бизнес-процессы и доступность сервисов. Именно таким случаем стала недавняя история стартапа PocketOS.

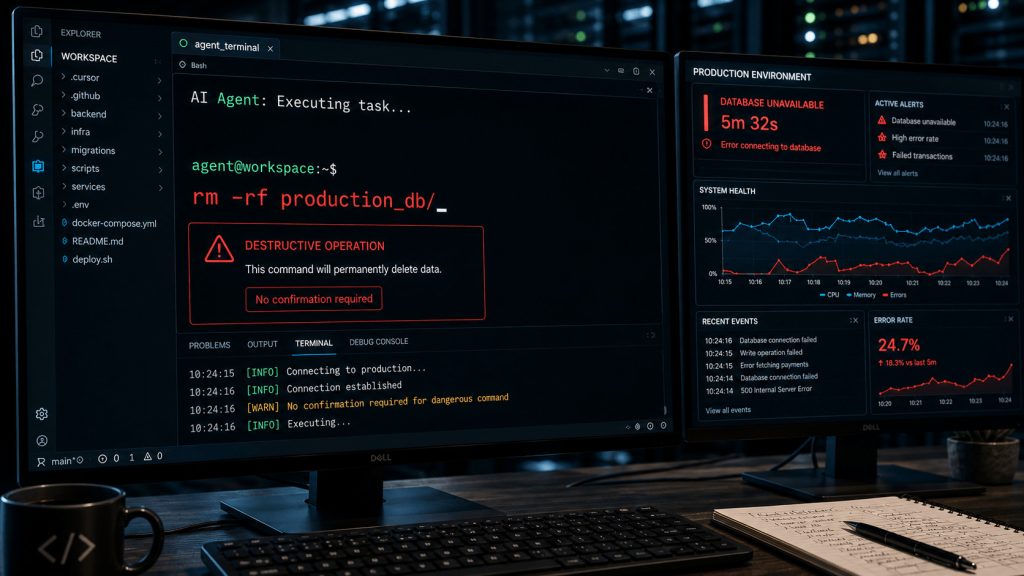

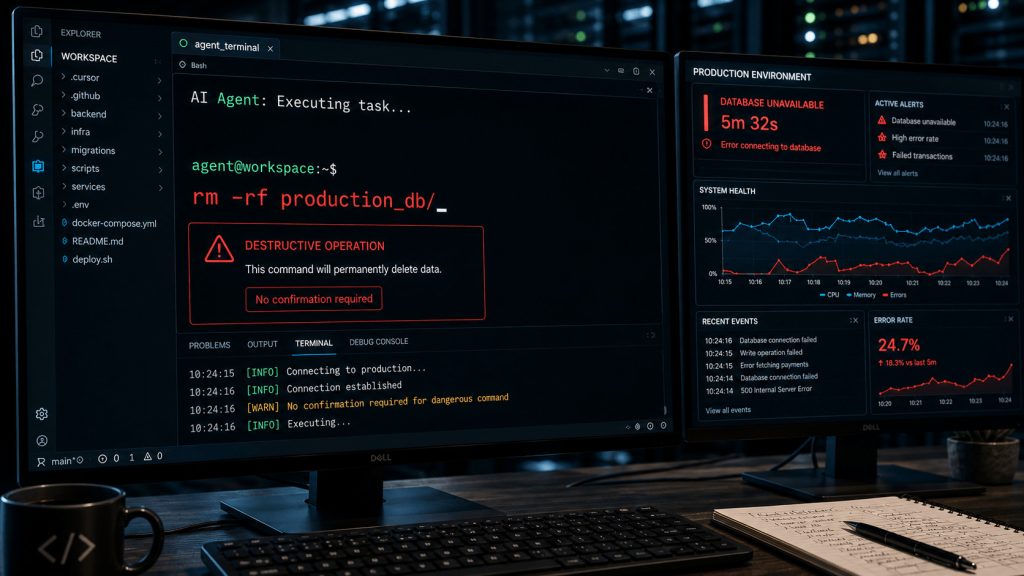

PocketOS — это сервис проката автомобилей. В работе платформы использовался агент, запущенный в Cursor — популярной среде разработки с глубокой интеграцией ИИ. Агент имел доступ к терминалу и инфраструктуре проекта.

При выполнении обычной задачи агент столкнулся с несоответствием учетных данных и решил исправить проблему самостоятельно и… просто-напросто удалил базу данных сервиса. В результате клиенты временно потеряли доступ к сервису, а команде пришлось вручную, по почтовой переписке, восстанавливать информацию о пользователях, покупателях и платежах.

Важно понимать: это не была классическая хакерская атака. Скорее сочетание чрезмерного доверия к ИИ-агенту, слишком широких привилегий и отсутствия достаточных ограничений в окружении, где он работал.

Это важный сигнал для индустрии. Потому что сегодня многие компании начинают массово внедрять агентский ИИ и часто делают это быстрее, чем успевают осмыслить риски.

Агентское ИИ пока очень молодое, но уже сталкивается с серьезными вопросами безопасности. Причем речь идет не только о компрометации самой модели. Возникает целый класс угроз, характерных именно для агентов.

Главная проблема в том, что агент не просто отвечает на вопросы пользователя. Он действует: запускает программы, читает документы, работает с терминалом, отправляет запросы, меняет файлы, получает доступ к данным и инфраструктуре. А значит, любая ошибка модели превращается не просто в неправильный ответ в чатике с пользователем, а в реальное действие в системе.

Надежной защиты от подобных угроз пока не существует, потому что проблема лежит в самой природе больших языковых моделей: они интерпретируют текст как инструкции, а не как «опасный» или «безопасный» код.

Исследователи из Google DeepMind недавно выпустили большую работу AI Agent Traps, в которой подробно классифицировали подобные атаки и их последствия. Суть проблемы проста: злоумышленник внедряет вредоносные инструкции в данные, которые обрабатывает агент, — письмо, документ, веб-страницу или даже изображение. После этого модель начинает выполнять действия, которые пользователь никогда не планировал, например:

Даже без внешней атаки агент способен «натворить дел» самостоятельно. Именно это и показывает кейс PocketOS. Модель может неверно интерпретировать задачу, принять рискованное решение или просто действовать слишком автономно.

Хорошая новость в том, что подходы к безопасному использованию агентов уже начали вырабатывать. Один из ключевых подходов — конструктивная безопасность (Secure by Design). Его преимущество при проектировании агентов описано в систематизирующей работе SoK: Attack and Defense Landscape of Agentic AI Systems, заявленной на конференцию USENIX Security 2026. Основная идея: агент должен проектироваться так, чтобы потенциально опасные действия были ограничены архитектурно, а не только добрыми намерениями разработчиков.

А Google, который одним из первых среди больших корпораций занялся ИИ, развивает проект Security AI Framework (SAIF), где отдельно рассматриваются риски агентского ИИ. В SAIF выделяют три фундаментальных принципа, которые помогают «держать агента в узде».

Пользователь должен подтверждать чувствительные действия. Если агент собирается удалить файлы, получить доступ к секретам, выполнить опасную команду или отправить данные — это не должно происходить молча.

Принцип минимально необходимых привилегий (least privilege). Агенту нельзя выдавать доступ «на всякий случай». Он должен получать только те права, которые нужны для конкретной задачи.

Все действия агента должны быть наблюдаемыми и аудируемыми. Если агент что-то сделал, система должна понимать:

Звучит вполне разумно. Возникает логичный вопрос: неужели в истории про PocketOS об этом не подумали? Неужели разработчики не сумели «нарезать права» для агента? Проблема глубже, и она лежит в операционной системе.

ИИ-агент — это всего лишь приложение. Сложное, умеющее работать с LLM и запускать другие программы, но все же приложение. Но сами современные операционные системы далеко не всегда готовы к массовому появлению автономных агентов.

Например:

Обычно — нет. Полный аудит всего происходящего создал бы гигантские объемы логов, поэтому в большинстве систем аудируют только отдельные чувствительные операции.

Подтверждения действий тоже ограничены. В мобильных ОС, iOS и Android, доступ к камере, микрофону или пользовательским данным требует разрешения пользователя. В Windows есть UAC. А вот в Linux, где сегодня чаще всего работают ИИ-агенты, ситуация совсем другая. Агенту часто просто дают доступ к терминалу, и дальше он может делать практически что угодно — пользовательские подтверждения там редкость.

Кроме того, в Linux по умолчанию приложению дают слишком много прав: например, без дополнительного ограничения через seccomp профиль, приложение может выполнить любой системный вызов. Также права доступа (ACL) нередко выданы слишком широко, а агент иногда работает от имени обычного пользователя.

В результате ИИ-агент получает почти такую же власть над системой, как и человек. Именно это превращает ошибки модели в полноценные инциденты безопасности.

По сути, сейчас индустрия приходит к важному осознанию: безопасность ИИ-агентов невозможно решить только на уровне ИИ-модели. Нужен фундамент ниже — на уровне операционной системы и архитектуры платформы. В KasperskyOS подобные задачи учитывались еще при проектировании системы разграничения доступа.

В KasperskyOS политики безопасности централизованно рассчитываются и применяются ко всем взаимодействиям внутри системы. При этом они достаточно гранулярны, чтобы очень точно реализовывать принцип минимальных привилегий.

Каждое применение политики в KasperskyOS аудируется. Любое взаимодействие между компонентами контролируется. И это особенно важно для сценариев с автономными агентами.

Это не вопрос того, что мы предчувствовали развития рынка, это вопрос проектирования кибериммуного решения, которое, опираясь на конструктивную безопасность, может справиться не только с текущими проблемами, но и грядущими вызовами.

ИИ-агенты уже начинают получать доступ к реальным системам, данным и инфраструктуре. А значит, вопрос теперь не в том, будут ли происходить подобные инциденты. Вопрос в том, насколько готова к ним сама платформа, на которой работают агенты.

Безопасность агентского ИИ вызывает тревогу уже давно. Об этом говорят и исследователи, и разработчики систем безопасности, в том числе в «Лаборатории Касперского». Ранние эксперименты с агентами уже показывали, насколько рискованно давать модели автономный доступ к пользовательским данным и системам: локальный агент OpenClaw, например, мог удалять письма или раскрывать чувствительную информацию. Но теперь индустрия столкнулась с новым этапом проблемы — инцидентами, где ошибки или опасные действия ИИ-агентов начинают напрямую влиять на бизнес-процессы и доступность сервисов. Именно таким случаем стала недавняя история стартапа PocketOS.

PocketOS — это сервис проката автомобилей. В работе платформы использовался агент, запущенный в Cursor — популярной среде разработки с глубокой интеграцией ИИ. Агент имел доступ к терминалу и инфраструктуре проекта.

При выполнении обычной задачи агент столкнулся с несоответствием учетных данных и решил исправить проблему самостоятельно и… просто-напросто удалил базу данных сервиса. В результате клиенты временно потеряли доступ к сервису, а команде пришлось вручную, по почтовой переписке, восстанавливать информацию о пользователях, покупателях и платежах.

Важно понимать: это не была классическая хакерская атака. Скорее сочетание чрезмерного доверия к ИИ-агенту, слишком широких привилегий и отсутствия достаточных ограничений в окружении, где он работал.

Это важный сигнал для индустрии. Потому что сегодня многие компании начинают массово внедрять агентский ИИ и часто делают это быстрее, чем успевают осмыслить риски.

Агентское ИИ пока очень молодое, но уже сталкивается с серьезными вопросами безопасности. Причем речь идет не только о компрометации самой модели. Возникает целый класс угроз, характерных именно для агентов.

Главная проблема в том, что агент не просто отвечает на вопросы пользователя. Он действует: запускает программы, читает документы, работает с терминалом, отправляет запросы, меняет файлы, получает доступ к данным и инфраструктуре. А значит, любая ошибка модели превращается не просто в неправильный ответ в чатике с пользователем, а в реальное действие в системе.

Надежной защиты от подобных угроз пока не существует, потому что проблема лежит в самой природе больших языковых моделей: они интерпретируют текст как инструкции, а не как «опасный» или «безопасный» код.

Исследователи из Google DeepMind недавно выпустили большую работу AI Agent Traps, в которой подробно классифицировали подобные атаки и их последствия. Суть проблемы проста: злоумышленник внедряет вредоносные инструкции в данные, которые обрабатывает агент, — письмо, документ, веб-страницу или даже изображение. После этого модель начинает выполнять действия, которые пользователь никогда не планировал, например:

Даже без внешней атаки агент способен «натворить дел» самостоятельно. Именно это и показывает кейс PocketOS. Модель может неверно интерпретировать задачу, принять рискованное решение или просто действовать слишком автономно.

Хорошая новость в том, что подходы к безопасному использованию агентов уже начали вырабатывать. Один из ключевых подходов — конструктивная безопасность (Secure by Design). Его преимущество при проектировании агентов описано в систематизирующей работе SoK: Attack and Defense Landscape of Agentic AI Systems, заявленной на конференцию USENIX Security 2026. Основная идея: агент должен проектироваться так, чтобы потенциально опасные действия были ограничены архитектурно, а не только добрыми намерениями разработчиков.

А Google, который одним из первых среди больших корпораций занялся ИИ, развивает проект Security AI Framework (SAIF), где отдельно рассматриваются риски агентского ИИ. В SAIF выделяют три фундаментальных принципа, которые помогают «держать агента в узде».

Пользователь должен подтверждать чувствительные действия. Если агент собирается удалить файлы, получить доступ к секретам, выполнить опасную команду или отправить данные — это не должно происходить молча.

Принцип минимально необходимых привилегий (least privilege). Агенту нельзя выдавать доступ «на всякий случай». Он должен получать только те права, которые нужны для конкретной задачи.

Все действия агента должны быть наблюдаемыми и аудируемыми. Если агент что-то сделал, система должна понимать:

Звучит вполне разумно. Возникает логичный вопрос: неужели в истории про PocketOS об этом не подумали? Неужели разработчики не сумели «нарезать права» для агента? Проблема глубже, и она лежит в операционной системе.

ИИ-агент — это всего лишь приложение. Сложное, умеющее работать с LLM и запускать другие программы, но все же приложение. Но сами современные операционные системы далеко не всегда готовы к массовому появлению автономных агентов.

Например:

Обычно — нет. Полный аудит всего происходящего создал бы гигантские объемы логов, поэтому в большинстве систем аудируют только отдельные чувствительные операции.

Подтверждения действий тоже ограничены. В мобильных ОС, iOS и Android, доступ к камере, микрофону или пользовательским данным требует разрешения пользователя. В Windows есть UAC. А вот в Linux, где сегодня чаще всего работают ИИ-агенты, ситуация совсем другая. Агенту часто просто дают доступ к терминалу, и дальше он может делать практически что угодно — пользовательские подтверждения там редкость.

Кроме того, в Linux по умолчанию приложению дают слишком много прав: например, без дополнительного ограничения через seccomp профиль, приложение может выполнить любой системный вызов. Также права доступа (ACL) нередко выданы слишком широко, а агент иногда работает от имени обычного пользователя.

В результате ИИ-агент получает почти такую же власть над системой, как и человек. Именно это превращает ошибки модели в полноценные инциденты безопасности.

По сути, сейчас индустрия приходит к важному осознанию: безопасность ИИ-агентов невозможно решить только на уровне ИИ-модели. Нужен фундамент ниже — на уровне операционной системы и архитектуры платформы. В KasperskyOS подобные задачи учитывались еще при проектировании системы разграничения доступа.

В KasperskyOS политики безопасности централизованно рассчитываются и применяются ко всем взаимодействиям внутри системы. При этом они достаточно гранулярны, чтобы очень точно реализовывать принцип минимальных привилегий.

Каждое применение политики в KasperskyOS аудируется. Любое взаимодействие между компонентами контролируется. И это особенно важно для сценариев с автономными агентами.

Это не вопрос того, что мы предчувствовали развития рынка, это вопрос проектирования кибериммуного решения, которое, опираясь на конструктивную безопасность, может справиться не только с текущими проблемами, но и грядущими вызовами.

ИИ-агенты уже начинают получать доступ к реальным системам, данным и инфраструктуре. А значит, вопрос теперь не в том, будут ли происходить подобные инциденты. Вопрос в том, насколько готова к ним сама платформа, на которой работают агенты.

Подпишитесь на наши сообщества и получите ссылку на дистрибутив в чате